En la saga de películas que tiene de protagonista al liquidador de la CIA Jason Bourne (interpretado por Matt Damon), hay varias escenas en las que los agentes oyen a distancia una conversación, aislándola del ruido ambiental. Hollywood exagera, pero algunos neurocientíficos están cada día más cerca de lograrlo. Un estudio publicado en Nature Neuroscience presenta el resultado de 14 años de trabajo: un dispositivo que descodifica las ondas cerebrales generadas cuando un humano se centra en oír una parte determinada del paisaje sonoro. Aún les quedan unos cuantos obstáculos, pero han abierto un camino a la esperanza para los millones de personas que tienen una discapacidad auditiva que les impide discriminar lo que quieren oír entre el ruido.

El implante descodifica las ondas cerebrales generadas por estímulos sonoros específicos como hace el ‘zoom’ de una cámara

En la saga de películas que tiene de protagonista al liquidador de la CIA Jason Bourne (interpretado por Matt Damon), hay varias escenas en las que los agentes oyen a distancia una conversación, aislándola del ruido ambiental. Hollywood exagera, pero algunos neurocientíficos están cada día más cerca de lograrlo. Un estudio publicado en Nature Neuroscience presenta el resultado de 14 años de trabajo: un dispositivo que descodifica las ondas cerebrales generadas cuando un humano se centra en oír una parte determinada del paisaje sonoro. Aún les quedan unos cuantos obstáculos, pero han abierto un camino a la esperanza para los millones de personas que tienen una discapacidad auditiva que les impide discriminar lo que quieren oír entre el ruido.

“Si bien las tecnologías actuales utilizan micrófonos direccionales, amplifican el sonido indiscriminadamente según el volumen o la dirección”, dice Nima Mesgarani, investigador del Instituto Zuckerman de la Universidad de Columbia (Estados Unidos) y autor sénior del estudio. Mesgarani señala el principal problema que comparten los modernos audífonos con la tecnología ficción de las películas: amplifican todo el sonido exterior. “Nuestro sistema actúa como una extensión neuronal [sic] que descodifica una intención específica a partir de las señales cerebrales para aislar la voz que se desea escuchar en tiempo real», añade en un correo.

Lo que han hecho parece ciencia ficción, pero viene de más de una década de investigación científica. En 2012, aparecía en Nature un trabajo de Mesgarani que bajo su capa de aridez de ciencia básica apuntaba cómo habían identificado la forma en la que el cerebro humano logra enfocar los estímulos sonoros como los ojos o las cámaras enfocan en un punto determinado del paisaje. Desde entonces, fue dando pasos en forma de artículos científicos que se iban acercando a su objetivo: diseñar un sistema que algún día permitiera a los que ya no pueden hacerlo de forma natural, volver a enfocarse en los sonidos que quieren.

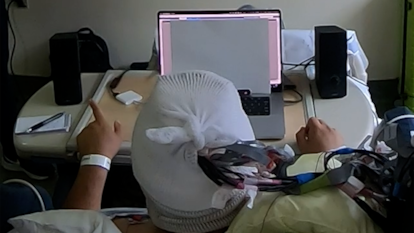

En el nuevo estudio, idearon una interfaz cerebro-máquina (BCI, por sus siglas en inglés) formada por un implante en el área del cerebro dedicada a descodificar los estímulos sonoros y un conjunto de algoritmos que, con la ayuda de la inteligencia artificial, identificaba la señal de las neuronas que se activaban cuando el individuo se concentraba en escuchar entre dos conversaciones que reproducían a la vez dos altavoces diferentes. Al iniciar la escucha, un oído y un cerebro sanos perciben algo parecido a una cacofonía, pero acaban por sintonizar, discriminando las distintas fuentes de sonido. Para el diseño de esta BCI, contaron con la ayuda de cuatro pacientes con epilepsia sometidos a cirugía cerebral para identificar con mayor precisión el origen de sus crisis epilépticas.

“Llevan toda la vida con epilepsia y han probado todo tipo de fármacos, así que querían curarse con electrodos”, cuenta José Luis Herrero, investigador riojano de la Escuela de Medicina Hofstra Northwell (Nueva York, Estados Unidos) y coautor de la investigación. Su equipo es el que le prestó a Mesgarani cuatro pacientes que se presentaron voluntarios. Aunque ellos no tienen ningún problema auditivo, “para llegar a las posibles áreas epileptogénicas teníamos que pasar por las zonas del cerebro que procesan la señal auditiva”, recuerda Herrero, también afiliado a los Institutos Feinstein para la Investigación Médica (también en Estados Unidos).

Con los electrodos ya implantados, los voluntarios tuvieron que oír dos conversaciones a la vez. Los investigadores probaron todo tipo de combinaciones: dos hombres que hablaban de hacer ejercicio, un hombre y una mujer de viajes, otra pareja intercambiando una receta. Y siempre con ruido de fondo, como el de una calle o un paso de peatones, con el ruido del tráfico, cláxones y transeúntes. Los participantes tenían que enfocarse en una de las charlas. “Es como cuando entras en un bar donde hay mucha gente hablando; el objetivo era ver cómo el cerebro se enfoca en una”, cuenta Herrero. Al hacerlo, se activaban unos electrodos y no otros. Ahí es donde entraba el trabajo acumulado del equipo de Mesgarani desde hace años.

Desde hace algo más de una década, tras la publicación de otro hallazgo en Science, la otra gran revista científica, Mesgarani y sus colegas comprobaron que una parte determinada del córtex dedicado a procesar las señales eléctricas procedentes del oído interno acumulaba todo el paisaje sonoro de un instante determinado. Entonces, una segunda zona del cerebro desagregaba todo el ruido en componentes sonoros inteligibles. Y el cerebro puede enfocar en unos u otros a voluntad del oyente.

En el nuevo trabajo, los científicos vieron que su BCI identificaba correctamente a qué conversación prestaban atención los voluntarios. El sistema entonces amplificaba esta señal, mejorando la inteligibilidad del habla en la que se concentraban y reduciendo el esfuerzo auditivo. Aun sin problemas de audición, los participantes siempre preferían oír las conversaciones con la BCI a cuando la apagaban. Pero había que probarlo con alguno de los 420 millones de personas que, sin ser sordas, tienen disminuida su capacidad auditiva.

Para ello reclutaron a 40 personas con problemas para procesar y discriminar entre el paisaje sonoro. “No llevaban implantes; simplemente escucharon los audios ya amplificados mediante las señales cerebrales de nuestros participantes principales y obtuvieron beneficios significativos, lo que confirma el potencial clínico del sistema”, destaca Mesgarani. “En resumen, demuestra que esta amplificación selectiva beneficia a las personas con pérdida auditiva incluso más que a las personas con audición normal”, termina.

Para Vishal Choudhari, primer autor de la investigación y que obtuvo su doctorado en ingeniería eléctrica en el laboratorio del doctor Mesgarani, la pregunta por responder era si “la tecnología de audición controlada por el cerebro podría ir más allá de los avances graduales y avanzar hacia un prototipo que pudiera ayudar a alguien a oír mejor en tiempo real”. Aunque, como bien dice, es solo un prototipo y aún queda mucho trabajo por hacer, “por primera vez, hemos demostrado que un sistema de este tipo, que lee las señales cerebrales para mejorar selectivamente las conversaciones, puede proporcionar un beneficio claro en tiempo real”.

“Para muchas personas con dificultades auditivas, el mayor problema no es el silencio, sino el ruido”, recuerda Eduardo Fernández, director del Instituto de Bioingeniería de la Universidad de Elche. “Los audífonos convencionales a menudo fallan porque amplifican todo el sonido ambiente, incluido el ruido de fondo, en lugar de centrarse solo en los sonidos de interés”, añade Fernández, que trabaja en el diseño de BCI, en su caso para personas con problemas de visión. “Un aspecto fundamental de esta investigación es el uso de registros intracraneales de alta resolución. Esta técnica es fundamental para lograr esta calidad de las señales, ya que los registros electrofisiológicos más habituales, que utilizan electrodos situados en la superficie de la cabeza, no permiten alcanzar estos resultados”, completa.

Ciencia en EL PAÍS